祝贺陈文智教授团队两篇论文同时被网络与信息安全领域顶级会议CCS 2023录用

2023年5月9日,浙江大学计算机系统结构实验室(ZJU ARClab)陈文智教授指导的两篇论文同时被CCS 2023录用,论文第一作者魏成坤、第二作者赵明虎和余瑞璟分别是ARClab博士后和在读硕士生。论文一“DPMLBench: Holistic Evaluation of Differentially Private Machine Learning”围绕差分隐私机器学习算法开展研究,论文二“Securely Sampling Discrete Gaussian Noise for Multi-Party Differential Privacy ”围绕差分隐私中的一类重要噪声开展研究。两篇论文被同时录用标志着陈文智教授团队在差分隐私研究领域取得重要进展。

会议介绍

CCS,全称 ACM Conference on Computer and Communications Security,是网络与信息安全领域的四大顶级会议之一,CCF推荐A类会议,每年论文录用率在20%左右。

论文一“DPMLBench: Holistic Evaluation of Differentially Private Machine Learning”

差分隐私机器学习算法的研究现状

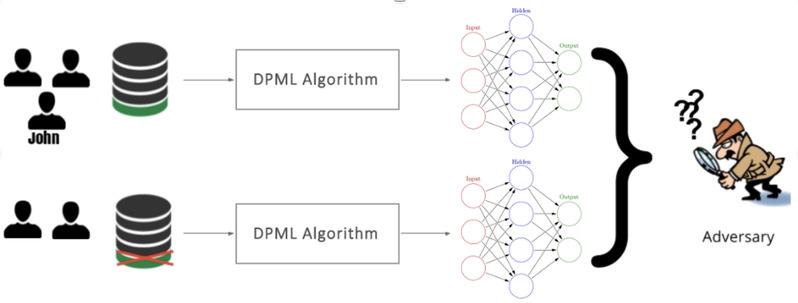

差分隐私(DP)是一种保护数据集中个体数据的隐私保护技术。它通过在进行任何分析或计算之前,向数据添加经过精确校准的噪声来实现这一目标。差分隐私机器学习是在机器学习中应用差分隐私,从而保护用于模型训练的数据隐私。其核心思想是确保对数据集进行的任何计算的输出不会透露任何有关个体数据样本的信息,同时仍然允许从数据中提取有用的信息。这其中一个重要的考虑因素是隐私和模型可用性之间的平衡。添加过多的噪声可能会导致模型准确性显著降低,而添加过少的噪声可能无法提供足够的隐私保证。为了在保护隐私的前提下尽可能少的损失性能,研究人员积极探索新技术和算法,以平衡隐私和模型性能,但是,这些研究是孤立的,不能准确的衡量算法改进在不同条件下的性能。更重要的是,缺乏全面的研究来比较这些DPML算法的改进在可用性、防御能力和通用性方面的表现。

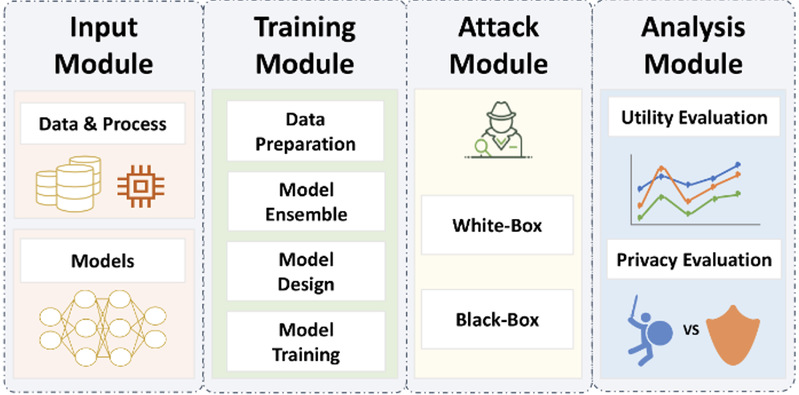

差分隐私机器学习算法的系统性测试评估

团队首先依据机器学习训练流程针对DPML算法提出了一种分类方法,从而为细致分析不同类别的算法的分析提供了便利。其次对先进的DPML算法的模型性能和对成员推理攻击的防御能力进行了大量的实验测量,得出了众多有利于业界后续研究的结论,同时团队还实现了一个模块化可重复使用的测试平台,DPMLBench,能够方便的使用和扩展差分隐私算法,方便隐私数据所有者可以轻松部署差分隐私算法,也可以作为相关领域研究人员的评估工具。

论文二“Securely Sampling Discrete Gaussian Noise for Multi-Party Differential Privacy ”

本文对差分隐私中一类重要噪声——离散高斯噪声提出了首个抗恶意的安全采样方法,可用于实现安全差分隐私机制。

安全多方差分隐私机制的研究现状

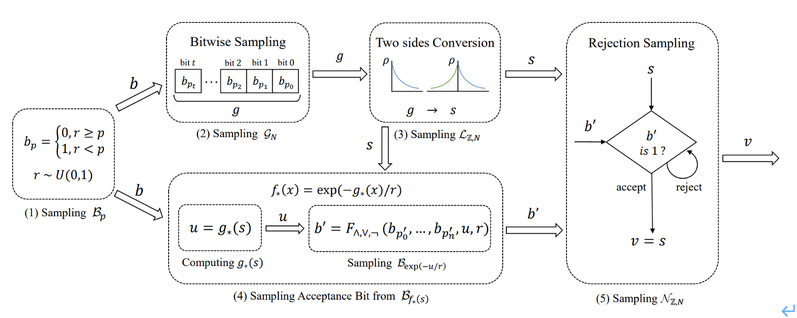

差分隐私是一种保护数据集中个体数据的隐私保护技术。它通过在进行任何分析或计算之前,向数据添加经过精确校准的噪声来实现这一目标。在多方场景中,通过结合安全多方计算技术可以在无需可信第三方的情况下实现安全差分隐私,同时保证结果的高可用性。噪声的安全采样是实现安全差分隐私的重要部分,目前差分隐私中的一种重要噪声——离散高斯噪声仅有半诚实安全的采样方案,无法对抗恶意攻击者。为了提供更强的安全性保证,本文提出了首个抗恶意安全的离散高斯噪声的安全采样方案。

离散高斯噪声的安全采样方法

本文的整体采样方案基于安全拒绝采样,所选取的辅助噪声为离散拉普拉斯噪声。团队首先通过异或技术得到安全均匀比特,在此基础之上采样后续噪声。对于离散拉普拉斯噪声,团队通过逐比特安全采样方法得到几何噪声,并转换得到离散拉普拉斯噪声。对于接受比特,团队利用伯努利噪声结合的特性将接受比特采样转换为多个伯努利噪声的结合。团队提出的安全噪声生成方案具有(1)通用性:支持不同噪声参数,参与方数量,底层安全多方计算协议和(2)高效性:整体采样方案主要包含高效的位运算操作。